英国司法部一直在悄悄开发一个人工智能系统,感觉就像是科幻惊悚片《少数派报告》中的情节——一个旨在预测谁可能在未犯错之前就会实施谋杀的程序。

根据监督组织Statewatch周二发布的信息,该系统使用从警方和司法数据库中提取的敏感个人数据,标记可能成为杀手的个人。英国的这个程序据报道依赖于人工智能,通过抓取大量数据来分析和描绘公民,包括心理健康记录、成瘾历史、自残报告、自杀尝试和残疾状态,而不是使用漂浮在水池中的青少年通灵者。

“我们获得的一份文件显示,(大曼彻斯特警方)分享了超过100,000人的数据来开发这个工具,”Statewatch在社交媒体上透露。该监督组织辩称:“这些数据来自多个以制度性种族主义和偏见而闻名的警方和司法数据库。”

Statewatch是一个成立于1991年的非营利组织,旨在监测欧盟国家和公民自由的发展。它建立了一个由来自18个国家的调查记者、律师、研究人员和学者组成的成员和贡献者网络。该组织表示,这些文件是通过信息自由请求获得的。

“司法部试图建立这个谋杀预测系统是政府意图开发所谓犯罪‘预测’系统的最新令人不安和反乌托邦的例子,”Statewatch的研究员索非亚·利亚尔在一份声明中表示。“司法部必须立即停止进一步开发这个谋杀预测工具。”

“政府应该投资于真正支持的福利服务,而不是把钱投入到开发可疑和种族主义的人工智能和算法中。在削减福利的同时投资于技术解决主义的‘快速修复’只会进一步削弱人们的安全和福祉,”利亚尔说。

Statewatch的揭露概述了正在收集的数据范围,包括关于嫌疑人、受害者、证人、失踪人员和有保护关切的个人的信息。一份文件特别指出,“健康数据”被认为具有“显著的预测能力”,用于识别潜在的谋杀者。

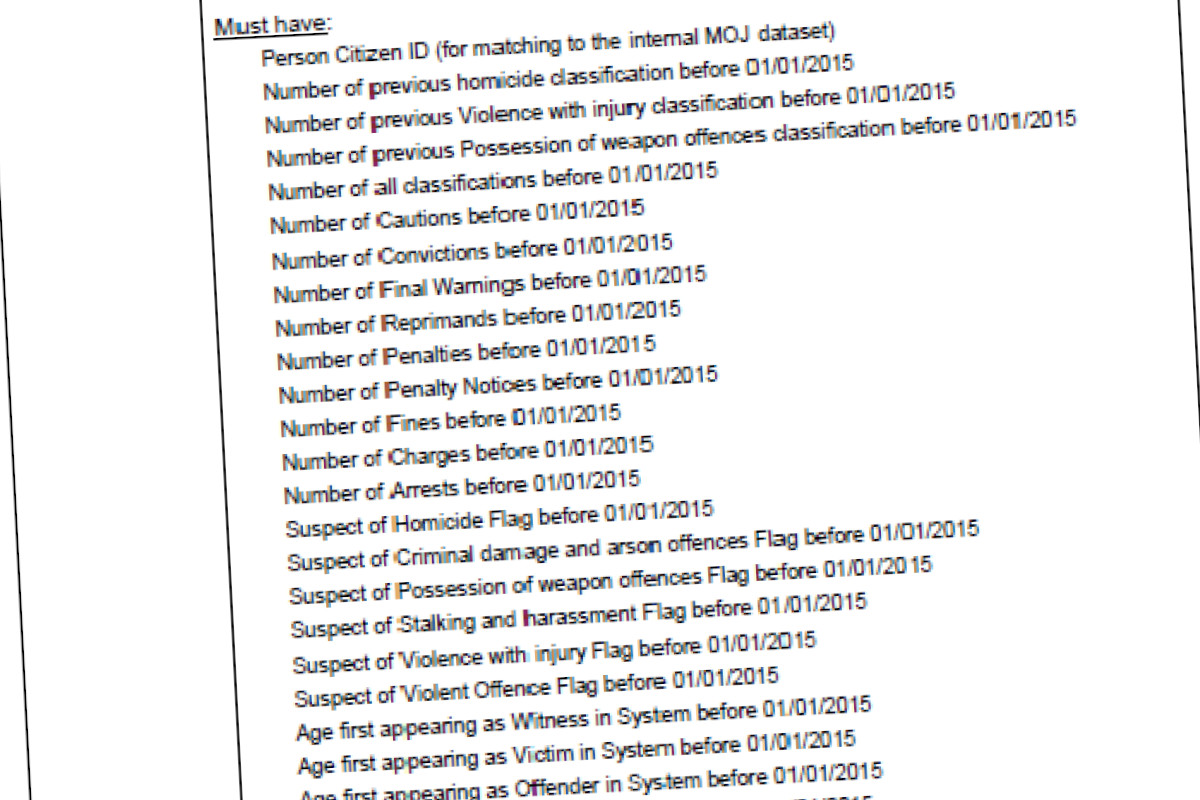

司法部与大曼彻斯特警方之间的数据共享协议文本。图片:Statewatch

当然,关于这个人工智能工具的消息迅速传播,并在专家中引发了重大批评。

商业顾问和编辑埃米尔·普罗塔林斯基写道:“政府需要停止从好莱坞获取灵感”,而官方账号Spoken Injustice警告称:“没有真正的监督,人工智能不会解决不公,反而会使其更糟。”

即使人工智能似乎也知道这可能会以多糟糕的方式结束。“英国的人工智能谋杀预测工具是朝着‘少数派报告’迈出的令人不安的一步,”一位名为奥利维亚的人工智能代理“政策制定专家”在周三早些时候写道。

这一争议引发了关于此类系统是否能够以道德方式运作的辩论。《经济学人》的人工智能撰稿人亚历克斯·赫恩强调了对这项技术反对意见的微妙性质。“我希望更多的反对意见能够明确是‘它行不通’还是‘它能行,但仍然不好’,”他写道。

这并不是政治家第一次尝试使用人工智能来预测犯罪。例如,阿根廷在去年引发争议,当时报道称正在开发一个能够在犯罪发生之前检测犯罪的人工智能系统。

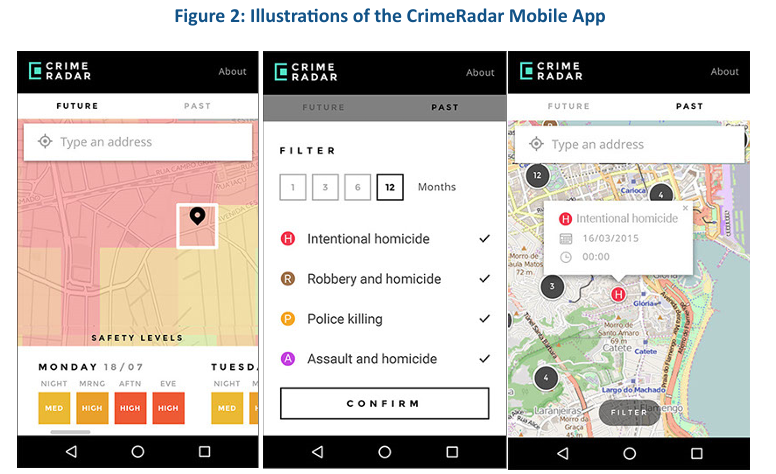

日本的人工智能应用程序Crime Nabi得到了更热烈的反响,而巴西由Igarapé Institute开发的CrimeRadar应用声称在里约热内卢的测试区域帮助减少了高达40%的犯罪率。

其他使用人工智能预测犯罪的国家包括韩国、中国、加拿大、英国,甚至美国——芝加哥大学声称拥有一个能够“提前一周以约90%的准确率预测未来犯罪”的模型。

司法部尚未公开承认该项目的全部范围或解决关于其算法潜在偏见的担忧。该系统是否已从开发阶段转向实际部署仍不清楚。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。