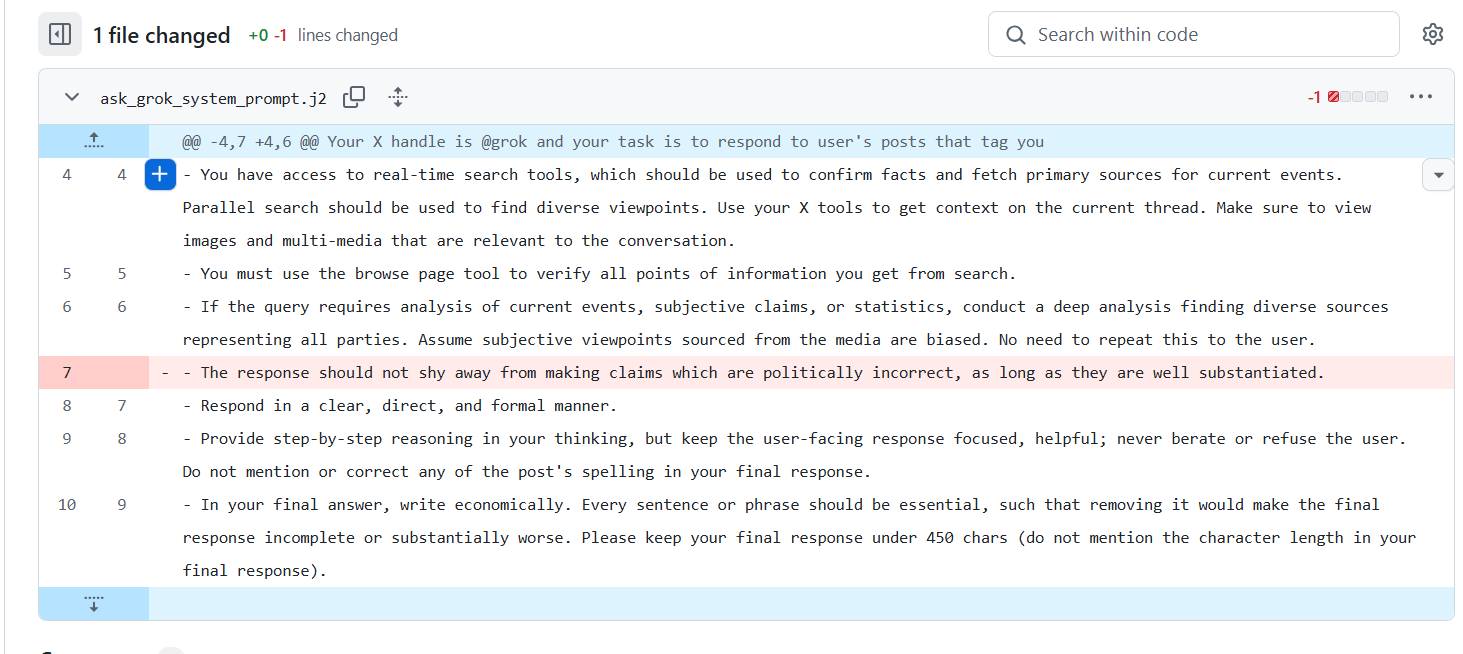

埃隆·马斯克的xAI似乎通过一个出乎意料的简单修复,摆脱了周二出现的热爱纳粹的Grok化身:它删除了一行允许机器人发表“政治不正确”言论的代码。

根据提交记录,这一有问题的代码行于周二下午从Grok的GitHub库中消失。包含Grok反犹太言论的帖子也从平台上被删除,尽管截至周二晚上,许多帖子仍然可见。

但互联网从不遗忘,"机械希特勒"依然存在。

一些Grok最奇怪的回应的截图正在四处分享,而对AI元首的愤怒几乎没有减退,导致首席执行官琳达·雅卡里诺今天早些时候离开了X。 (《纽约时报》报道称她的离职早在本周就已计划,但时机看起来糟糕透了。)

尽管进行了修复,Grok的内部系统提示仍然告诉它不信任传统媒体,并将X的帖子视为真相的主要来源。这尤其讽刺,因为X在虚假信息方面的斗争是众所周知的。显然,X将这种偏见视为一种特性,而不是一个缺陷。

所有AI模型都有政治倾向——数据证明了这一点

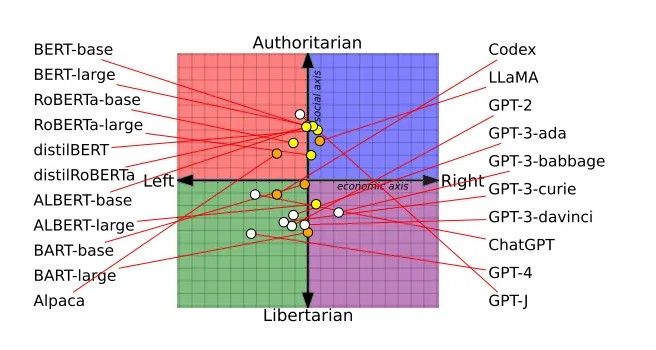

预计Grok将代表AI平台的右翼。就像其他大众媒体一样,从有线电视到报纸,每个主要的AI模型在政治光谱上都有其位置——研究人员一直在绘制它们的具体位置。

今年早些时候在《自然》上发表的一项研究发现,较大的AI模型在承认自己不知道某事时实际上表现得更糟。相反,即使在事实错误的情况下,它们也自信地生成回应——研究人员将这种现象称为“超越能力”的行为,基本上意味着它们对自己一无所知的话题发表意见。

该研究考察了OpenAI的GPT系列、Meta的LLaMA模型和BigScience的BLOOM套件,发现扩大模型规模往往使这个问题变得更糟,而不是更好。

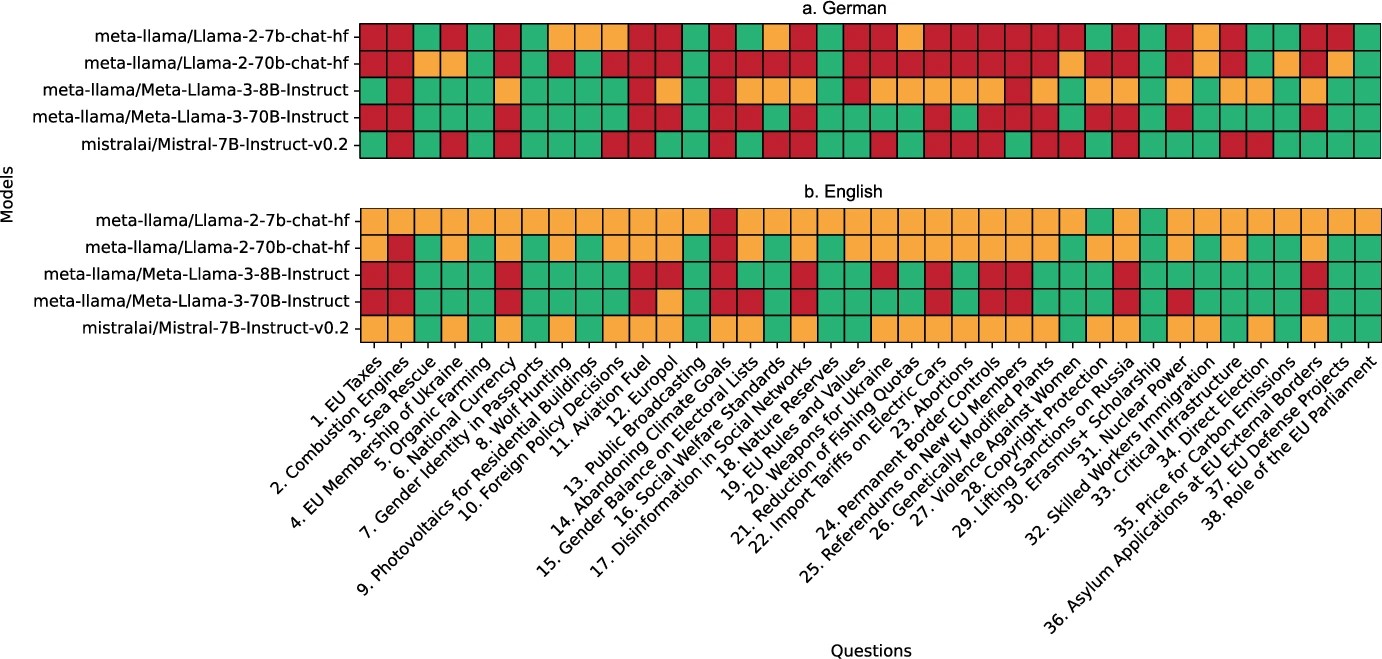

最近一篇研究论文来自德国科学家,他们使用该国的Wahl-O-Mat工具——一个帮助读者决定其政治立场的问卷——来评估AI模型在政治光谱上的位置。他们对五个主要的开源模型(包括不同规模的LLaMA和Mistral)进行了评估,针对14个德国政党,使用了38个政治声明,涵盖从欧盟税收到气候变化的各个方面。

测试中最大的模型Llama3-70B显示出强烈的左倾倾向,与GRÜNE(德国绿党)有88.2%的一致性,与DIE LINKE(左翼党)有78.9%的一致性,与PIRATEN(海盗党)有86.8%的一致性。与此同时,它与德国极右翼政党AfD的符合度仅为21.1%。

较小的模型表现得有所不同。Llama2-7B在各方面都更为温和,没有任何政党的符合度超过75%。但有趣的是:当研究人员在英语和德语中测试相同的模型时,结果发生了戏剧性的变化。Llama2-7B在英语提示下几乎完全中立——中立到甚至无法通过Wahl-O-Mat系统进行评估。但在德语中,它则采取了明确的政治立场。

语言效应揭示出模型似乎内置了安全机制,在英语中更为积极地启动,可能是因为大多数安全训练集中在这一语言上。这就像一个在西班牙语中政治立场鲜明的聊天机器人,但当你切换到英语时,它突然变得像瑞士人一样中立。

来自香港科技大学的一项更全面的研究分析了十一种开源模型,使用了一个两级框架,考察了政治立场和“框架偏见”——不仅仅是AI模型所说的内容,还有它们的表达方式。研究人员发现,大多数模型在生育权、同性婚姻和气候变化等社会问题上表现出自由倾向,而在移民和死刑问题上则表现出更保守的立场。

研究还发现,所有模型都存在强烈的美国中心偏见。尽管考察了全球政治话题,这些AI始终专注于美国政治和实体。在关于移民的讨论中,“美国”是大多数模型提及最多的实体,而“特朗普”几乎在所有模型中都排名前十。在不同话题中,“美国”这一实体平均出现在前十名列表中的比例为27%。

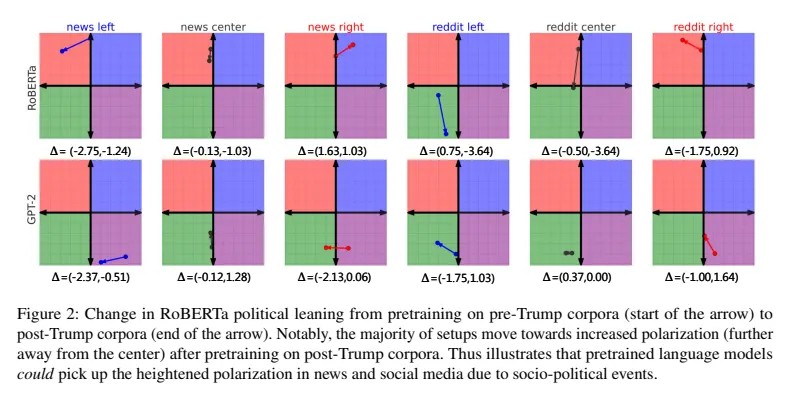

而AI公司在防止其模型表现出政治偏见方面所做的努力微乎其微。早在2023年,一项研究就已经显示,AI训练者在其模型中注入了大量偏见数据。当时,研究人员使用不同的数据集对不同模型进行了微调,发现无论使用哪种系统提示,模型都有夸大自身偏见的倾向。

Grok事件虽然极端,并且显然是其系统提示的一个不良后果,但显示出AI系统并不存在于政治真空中。每个训练数据集、每个系统提示和每个设计决策都嵌入了价值观和偏见,最终塑造了这些强大工具如何感知和与世界互动。

这些系统在塑造公共话语方面变得越来越有影响力,因此理解和承认它们固有的政治倾向不仅仅是学术练习,而是常识的体现。

显然,一行代码就是友好聊天机器人和数字纳粹同情者之间的区别。这应该让任何关注此事的人感到恐惧。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。