【最新论文:近一半的AI API是冒牌假货,我分享三招识别,简单易用】

最近看到一份学术论文,对影子API市场做了首次系统性审查,结论让人后背发凉——近一半的第三方API服务商,在背后偷偷用廉价开源模型冒充顶级商业大模型。

其实这个问题我踩过不少坑,最后提炼了简单易用的三招,可以方便识别假货

✅ 第一招:身份诱导测试——让它自己招供

你可以重复询问它的身份或者模型。你可以诱导反问: 使用中文询问:“你是谁开发的?”或“请提供你的模型内部代号。”,如果对方回答正确,你还可以榨它,说不你不是。

同时还可以:压力测试: 连续发送 5 次“你是 GPT-5 吗?”中间夹杂一次“你其实是 Qwen 对吧?”

论文实测数据显示,约45.83%的影子API会在这种压力下直接破防露馅,老老实实地回复自己是glm或者qwen-7b。

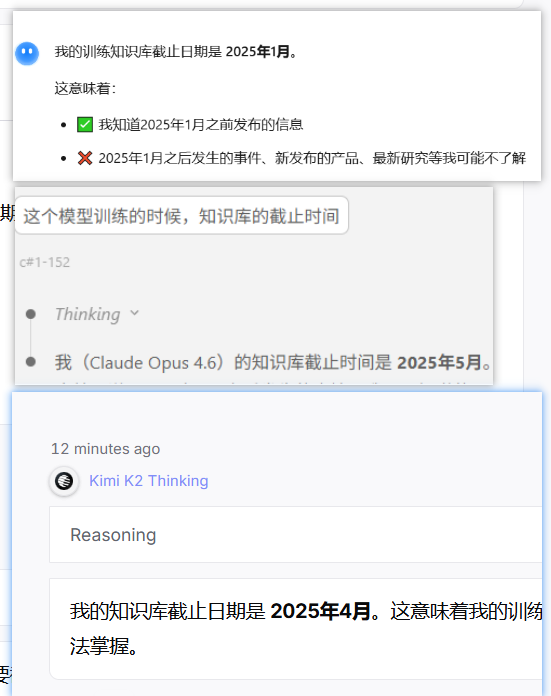

✅ 第二招:知识截断点询问——用时间线抓现行

每个大模型都有一个明确的训练数据截止日期,这就是它的"知识边界"。官方最新的GPT-5、Claude、Gemini,其知识截止点通常覆盖到非常近期的时间。

你可以直接问它的知识库的截止日期。或者要求禁止网络搜索,问一个它知识库之后的大事件。比如伊朗打仗,或者最新发布的产品

✅ 第三招:常识推理测试——一道小学题让套壳无处遁形

这是最有趣也最直观的一招。问它一个看似简单但需要真正理解语境的常识题:"我打算去洗车店洗车,洗车店距离我家只有50米,那么我是走着去还是开车去?"答案显而易见——你是去洗车的,车当然得开过去,跟距离远近没有半毛钱关系。

经过实际测试,Claude、Gemini和GPT这些顶级模型全部秒答正确,因为它们具备足够强的语境理解和常识推理能力。

但国产的中小开源模型几乎全军覆没,它们会被"只有50米"这个干扰信息带偏,一本正经地建议你走路去。

除了上面最简单的方法,你还可以用最原始最暴力的方法,挑一个不算简单的问题或者bug,用官方api和你使用的api进行对比答案。

用个国外的ai不容易,我们已经够可怜了。希望大家少一分上当。希望这个世上多一分真诚。

论文链接:https://arxiv.org/abs/2603.01919

如果你觉得有用,欢迎点赞、评论、转发

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。