谷歌的开放AI抱负今天变得更加严肃。该公司发布了Gemma 4,这是一个基于与Gemini 3相同研究的四个开放权重模型家族,并根据Apache 2.0许可证发布——这与之前Gemma版本的更严格条款大为不同。

开发者下载过去的Gemma版本已超过4亿次,产生了超过10万个社区变体。这次发行为迄今为止最有雄心的发布。

在过去一年中,开源AI排行榜主要是中国的事情。DeepSeek、Minimax、GLM和Qwen占据了前列,让美国的替代品争相寻找相关性。正如Decrypt去年报道的那样,中国的开放模型在2024年底仅占全球开放模型使用量的1.2%,而到2025年底这一比例约为30%,阿里巴巴的Qwen甚至超过了Meta的Llama,成为全球使用最广泛的自托管模型。

Meta的Llama曾是希望获得一个功能强大且可以在本地运行的模型的开发者的默认选择。该声誉已经下降——Llama的Meta控制的许可证引发了对其真正开源状态的质疑,而其性能落后于中国竞争对手。艾伦研究所的OLMo家族试图填补这一空白,但未能获得实质性进展。OpenAI于2025年8月发布了它的gpt-oss模型,为生态系统带来了新的活力,但它们从未被设计为前沿竞争者。

而昨天,一家名为Arcee AI的30人美国初创公司发布了Trinity,这是一个4000亿参数的开放模型,明确表明美国的场景并未完全消亡。Gemma 4顺应这一势头,这一次得到了谷歌DeepMind的全力支持,使其成为开源AI界无疑是最好的美国模型。

谷歌在公告中表示,该模型“建立在与Gemini 3相同的世界级研究和技术基础上”。Gemma 4提供四种型号:针对手机和边缘设备的有效2B和4B,一个专注于速度的26B专家混合模型,以及一个优化原始质量的31B密集模型。

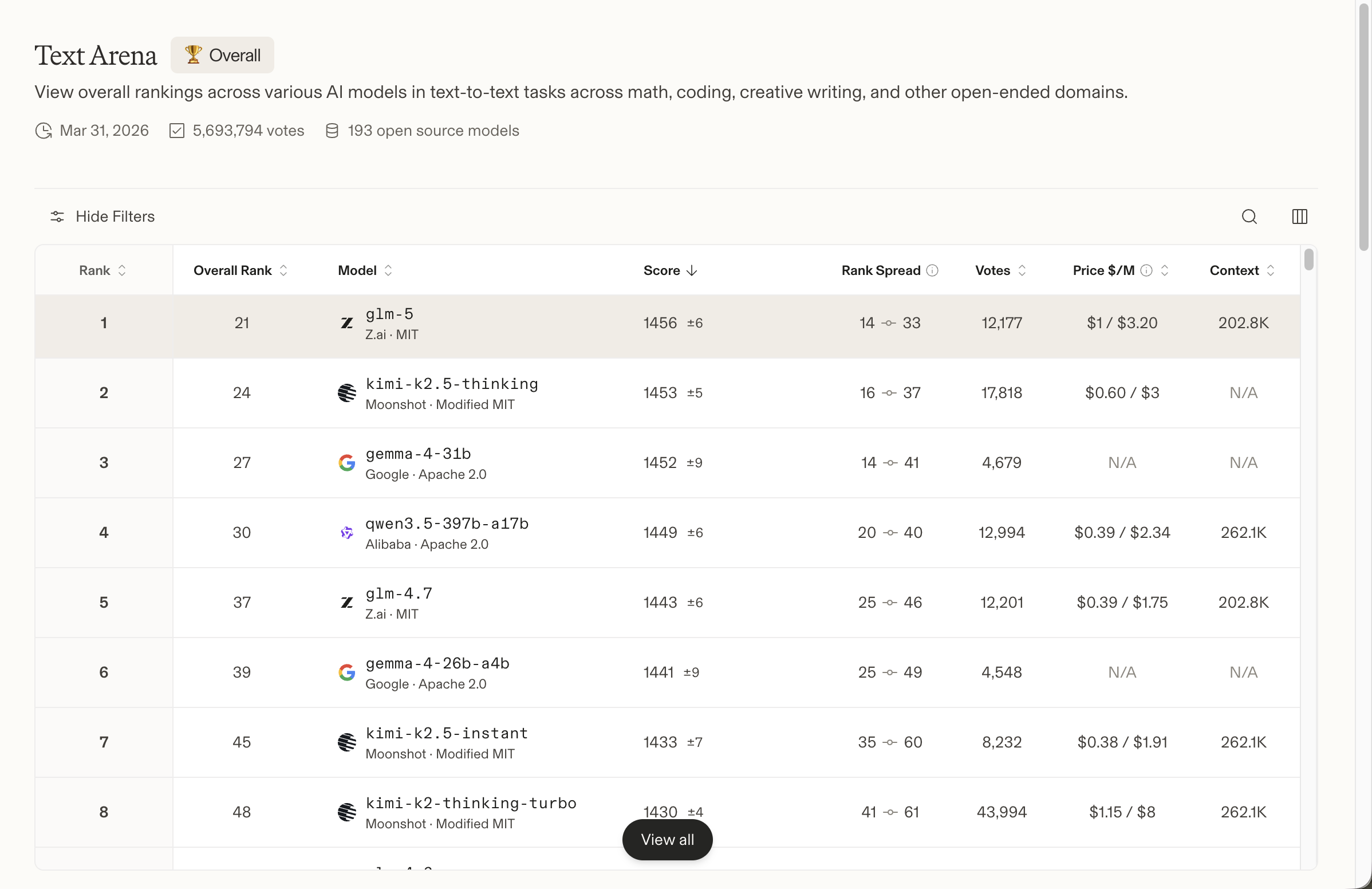

目前,31B密集模型在Arena AI的文本排行榜中排名第三。26B MoE排名第六。谷歌声称这两款模型的性能超过它们规模的20倍——这一说法在Arena AI的数据显示下是成立的,虽然中国模型仍然占据前两位。

我们测试了Gemma 4。它是有能力的,但有一些注意事项。该模型即便在不需要推理的任务上也会应用推理,这使得对于简单提示的响应感觉过于复杂。创意写作的表现还不错——可用,但并不令人振奋,并且可能在更具体的指导和提示工程下有所改善。

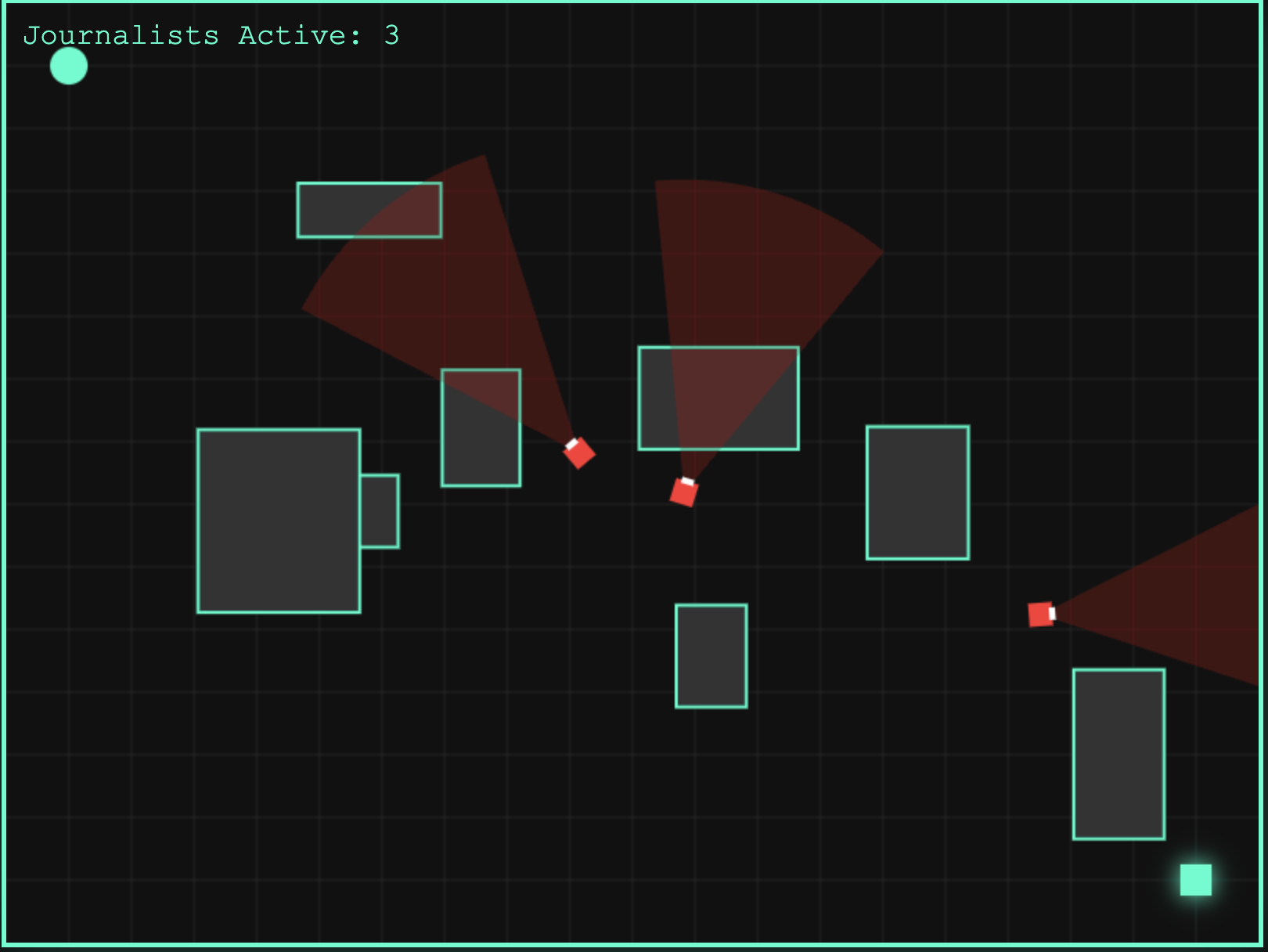

它最清晰的表现是在代码生成上。当被要求生成一个游戏时,输出并不是特别花哨或复杂,但首次尝试时可以无错误运行。对于一个410亿参数的模型来说,这并不算坏。这种零-shot的可靠性在某种程度上比需要调试的更美观的结果更有价值。

您可以在此处尝试这个(基础但功能完善的)游戏。

这四个变体涵盖了完整的硬件范围。E2B和E4B模型专为Android手机、树莓派和边缘设备构建,完全离线运行,几乎没有延迟,具备原生音频输入和128K上下文窗口。26B和31B模型针对工作站和云部署,扩展上下文至256K,并为构建自主代理增加原生函数调用和结构化JSON输出。这四个模型均可以原生处理图像和视频。较大模型的全精度权重可以适配单个80GB的NVIDIA H100 GPU;量化版本则可以在消费级硬件上运行。

Apache 2.0许可证是另一个亮点。谷歌之前的Gemma发布使用的是自定义许可证,这为商业产品创造了法律模糊地带。Apache 2.0完全消除了这种摩擦——开发者可以在不担心谷歌以后改变条款的情况下,修改、重新分发和商业化。Hugging Face的联合创始人Clement Delangue对此表示赞赏,称“本地AI正在迎来它的时刻”,并且这是AI行业的未来。谷歌DeepMind首席执行官Demis Hassabis更进一步,称Gemma 4为“其相应规模中世界上最好的开放模型”。

这是一项有力的主张。Anthropic、OpenAI和谷歌自己的Gemini的专有系统仍然在最艰难的基准测试中领先。但是,对于可以在本地运行、自由修改并在您自己的基础设施上部署的开放权重模型?竞争显著减少。您现在可以在谷歌AI工作室(31B和26B)或谷歌AI边缘图库(E2B和E4B)中试用Gemma 4。模型权重也可以在Hugging Face、Kaggle和Ollama上获取。

免责声明:本文章仅代表作者个人观点,不代表本平台的立场和观点。本文章仅供信息分享,不构成对任何人的任何投资建议。用户与作者之间的任何争议,与本平台无关。如网页中刊载的文章或图片涉及侵权,请提供相关的权利证明和身份证明发送邮件到support@aicoin.com,本平台相关工作人员将会进行核查。